ChatGPTの個人情報漏洩を防ぐには?漏洩が起こり得る原因と企業が実践すべき対策

「ChatGPTを活用して業務の自動化を図りたいが情報漏洩は避けたい」

「ChatGPTを安全に利用できる方法を知りたい」

業務にAIの導入を検討している方の中には、上記のお悩みを抱えている方もいるでしょう。

ChatGPTは便利なツールですが、使い方を間違えると機密情報が外部に漏れる危険性があります。企業で導入する際は、リスクを正しく理解し、対策を講じなければなりません。

本記事では、ChatGPTで個人情報漏洩が起こりえる理由や実際の事例、具体的な対策を詳しく解説します。

▼Chat GPTを活用した業務の自動化を安全・安心に進めたいなら、「workrun」!

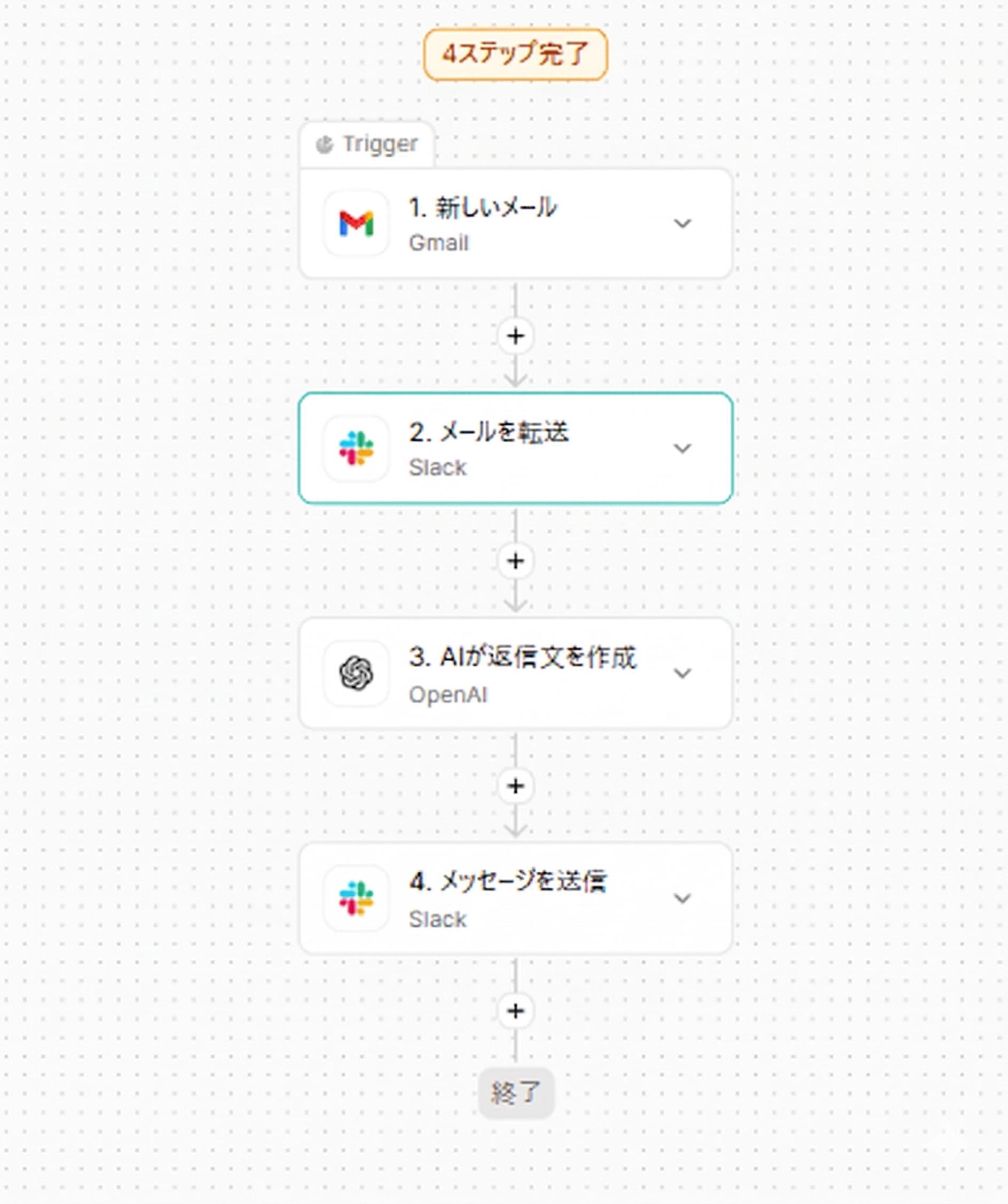

workrunは、国内サーバーで運用される、さまざまなツールやChat GPTなどのAIをつなぎ、業務を自動化できるAIワークフロー自動化ツールです。

workrunなら、ChatGPTと連携したワークフローを、ドラッグ&ドロップの直感的な操作で簡単に作成できます。

作成したワークフローは24時間365日自動で稼働し、問い合わせ対応や請求処理などの業務を人手を介さず実行可能です。

また、ChatGPTに直接データを入力する必要がないため、情報漏洩リスクを抑えながらAI活用を推進できます。

セキュリティを担保しつつ、業務効率化と生産性向上を実現したい方におすすめのツールです。

目次[非表示]

- ・ChatGPTで個人情報漏洩が起こり得る3つの理由

- ・ChatGPTの利用で知っておくべき規制の動向

- ・ChatGPTで実際に起きた3つの情報漏洩事例

- ・ChatGPTの情報漏洩を防ぐ7つの対策

- ・個人情報・機密情報は入力しない(ダミー化・マスキングの活用)

- ・オプトアウト設定で学習をオフにする

- ・Temporary Chat・履歴オフ機能を活用する

- ・API経由で利用する

- ・法人向けプラン(Team / Enterprise)を選択する

- ・アカウントのセキュリティを強化する(多要素認証・パスワード管理)

- ・DLP・ログ監視ツールで入力内容をモニタリングする

- ・企業がChatGPTを安全に業務利用するための3つのポイント

- ・ChatGPTを活用した業務効率化なら「workrun」の安心・安全なAIワークフロー

- ・ChatGPTを安全に利用できる社内体制を構築しよう

ChatGPTで個人情報漏洩が起こり得る3つの理由

ChatGPTを利用する際に情報漏洩の危険性がある理由として以下3つが挙げられます。

AIによる入力データの学習利用

アカウント情報の流出・不正アクセス

システムバグによるチャット履歴の誤表示

それぞれの仕組みや背景を詳しく見ていきましょう。

AIによる入力データの学習利用

ChatGPTは、ユーザーが入力した文章を人工知能の精度向上に利用する仕組みを備えています。

Webブラウザ版を利用する場合、入力した文章は運営会社であるOpenAIのサーバーに送信され、保存されるのが特徴です。保存されたデータは、新たな回答を生成するための学習素材となる可能性があります。

つまり、会社の機密情報を含む文章を入力した場合、別のユーザーへの回答として同じ情報が出力されてしまう危険があります。業務で利用する際は、入力する情報の内容に十分な注意を払わなければなりません。

アカウント情報の流出・不正アクセス

悪意のあるソフトウェアによって、ChatGPTのアカウント情報が盗み出される被害が多数報告されています。

インフォスティーラーと呼ばれる情報を盗み取るプログラムに感染すると、ログインに必要なIDやパスワードが流出してしまいます。盗まれた情報は、インターネット上の匿名性の高い空間であるダークウェブで売買されるケースが少なくありません。

第三者にアカウントへ不正アクセスされると、過去のやり取りをすべて見られてしまい、深刻な情報漏洩に発展する危険があります。

システムバグによるチャット履歴の誤表示

システムの不具合によって、別のユーザーの画面に自分の情報が表示されてしまうトラブルも発生しています。

過去には、OpenAIのシステムで問題が起き、他人が作成したチャットのタイトルが見えてしまう事象がありました。利用者側がどれだけ気をつけていても、サービスを提供する側の問題で情報が漏れる危険性はゼロではありません。

システム側の不具合を完全に防ぐのはむずかしいため、万が一漏れても問題ない情報だけを入力する運用が求められます。

ChatGPTの利用で知っておくべき規制の動向

人工知能の利用拡大にともない、世界各国で法的な規制やルールの整備が進んでいます。主な動向として以下が挙げられます。

日本の個人情報保護委員会による注意喚起

入力データに対する法的解釈の議論

ヨーロッパにおける厳格な利用制限の事例

各国の政府や公的機関は、人工知能による個人情報の取り扱いに警戒を強めています。日本の個人情報保護委員会も、生成AIサービスを利用する際の個人データの取り扱いに関して注意喚起を行いました。

ChatGPTへ個人データを入力する行為は、個人情報保護法の「外国にある第三者への提供」に該当する可能性があります。

また、ヨーロッパではGDPRと呼ばれる厳格なデータ保護規則に違反するとして、イタリアが一時的にChatGPTの利用を禁止した事例もあります。

企業で利用する際は、各国の法律や規制の動向を常に把握し、ルールに沿った運用を心がけましょう。

参考:生成AIサービスの利用に関する注意喚起等について|個人情報保護委員会

ChatGPTで実際に起きた3つの情報漏洩事例

ChatGPTで実際に起きた情報漏洩事例を3つ紹介します。

サムスン電子|社員が機密コードを入力し全社利用禁止に

ChatGPT Plus|約1.2%のユーザー個人情報が流出

ダークウェブ|2,000万件超のOpenAIアカウント認証情報が売買

過去の事例から、具体的な危険性を学んでいきましょう。

サムスン電子|社員が機密コードを入力し全社利用禁止に

韓国のサムスン電子では、社員が業務の短縮化を目的に機密情報を入力し、深刻な情報漏洩を引き起こしました。

プログラムの不具合修正や会議の議事録作成を理由に、自社の重要なデータをChatGPTに入力してしまったのが原因です。導入からわずか数週間で複数の漏洩事故が発生したため、同社は緊急措置として入力できる文章の長さを制限しました。

最終的に、サムスン電子は社内での生成AIの利用を全面的に禁止する厳しい対応をとっています。

ChatGPT Plus|約1.2%のユーザー個人情報が流出

有料プランであるChatGPT Plusでは、システムの問題により一部利用者の個人情報が別の利用者に表示される事故が起きました。

OpenAIがシステムで使用しているプログラムの部品に不具合があり、約1.2%の利用者の氏名、メールアドレス、住所、クレジットカード情報の一部が漏洩しました。

運営会社はただちにサービスを一時停止し、問題の修正と再発防止策を講じています。

有料プランであってもシステム上の問題による漏洩リスクがある事実は、企業利用で重要な教訓となるでしょう。

ダークウェブ|2,000万件超のOpenAIアカウント認証情報が売買

インターネット上の闇市場であるダークウェブで、大量のChatGPTアカウント情報が取引されている事実が確認されています。

海外のセキュリティ企業の調査によると、情報を盗み取るマルウェアによって、10万件以上のアカウント情報が盗み出されました。

流出したアカウントを使って第三者がログインすれば、過去に入力した機密情報や個人情報がすべて閲覧されてしまいます。

また、個人の端末がウイルスに感染した場合、会社のアカウント情報まで流出してしまう危険性があります。

ChatGPTの情報漏洩を防ぐ7つの対策

ChatGPTの情報漏洩を防ぐ7つの対策は以下のとおりです。

個人情報・機密情報は入力しない(ダミー化・マスキングの活用)

オプトアウト設定で学習をオフにする

Temporary Chat・履歴オフ機能を活用する

API経由で利用する

法人向けプラン(Team / Enterprise)を選択する

アカウントのセキュリティを強化する(多要素認証・パスワード管理)

DLP・ログ監視ツールで入力内容をモニタリングする

情報漏洩を防ぐためには、具体的な対策を講じる必要があります。それぞれの対策に関して、具体的な設定や方法を解説します。

個人情報・機密情報は入力しない(ダミー化・マスキングの活用)

基本的かつ重要な対策は、個人名や顧客データなどの機密情報をそのまま入力しない運用を徹底することです。

実際の社名や金額を、架空の名称や数字に置き換えるダミー化を活用しましょう。重要な部分を黒塗りにして隠すマスキングと呼ばれる手法も有効です。

文章を入力する前に、機密情報が含まれていないか目視でチェックするなどの社内ルールを設けることも必要でしょう。

オプトアウト設定で学習をオフにする

ChatGPTの設定画面から、自身の入力したデータが人工知能の学習に使われないようにするオプトアウト設定が可能です。該当の設定を有効にすると、入力した文章がAIモデルの改善に利用されなくなります。

設定を変更するには、ChatGPTの画面内にあるデータコントロールのメニューを開き、「すべての人のためにモデルを改善する」の項目をオフにします。

業務で利用するアカウントでは、学習機能を無効にしておきましょう。

Temporary Chat・履歴オフ機能を活用する

履歴を残したくない場合は、Temporary Chatと呼ばれる一時的な会話機能を使う方法があります

Temporary Chatは、設定画面のメニューから、過去のやり取りを保存しない状態に変更できます。

一時的な会話機能を利用したやり取りは、履歴に保存されず、人工知能の学習にも使われません。履歴を残さない運用は、万が一アカウントが乗っ取られた際の情報漏洩リスクを下げる役割も果たします。

API経由で利用する

外部システムと連携するための窓口であるAPIを経由してChatGPTを利用すれば、入力したデータは学習に使われません。

APIを利用して自社専用の環境を構築すると、入力した情報が外部に共有されるリスクを減らせます。機密情報を頻繁に扱う業務では、Webブラウザ版ではなくAPI版の利用が推奨されます。

自社のシステムに直接AIを組み込むため、より安全な環境で業務の自動化を進められるはずです。

法人向けプラン(Team / Enterprise)を選択する

企業で安全に利用するためには、法人向けに提供されているTeamプランやEnterpriseプランの契約がおすすめです。

法人向けプランでは、入力したデータが人工知能の学習に利用されない仕様になっています。特にEnterprise版は、国際的な防犯基準を満たしており、すべての会話データが暗号化されて保存されます。

また、法人向けプランは管理者専用の画面を含む、企業向けの管理機能が充実しているのもメリットです。

▼会社でChatGPTの導入を検討している方は、以下の記事もご確認ください。

>> 企業向けChatGPTとは?Business/Enterpriseの違いと導入方法・注意点を解説

アカウントのセキュリティを強化する(多要素認証・パスワード管理)

パスワードの定期的な変更と、他のサービスとの使い回しを避ける運用は、情報漏洩の基本的な対策です。

ログイン時にパスワード以外の確認を求める多要素認証を有効にすると、不正アクセスのリスクを大幅に下げられます。

また、ログイン履歴を定期的に確認し、身に覚えのない不審なアクセスがないか監視する体制も重要です。アカウントの管理を徹底し、第三者に侵入される隙を与えない運用を心がけてください。

DLP・ログ監視ツールで入力内容をモニタリングする

情報漏洩を防ぐシステムであるDLPツールを導入し、従業員が機密情報を入力する行為を自動的に検知して制御する仕組みが有効です。

操作履歴を記録するツールを活用し、誰がどのような情報を入力したか管理できる体制を整えましょう。セキュリティ対策ソフトと連携させれば、情報を盗み取るウイルスの侵入を防ぐ役割も果たします。

また、システムによる監視体制を敷くため、人為的なミスによる漏洩を未然に防ぐのにつながります。

企業がChatGPTを安全に業務利用するための3つのポイント

企業がChatGPTを安全に業務利用するための3つのポイントは以下のとおりです。

社内でAI利用ガイドラインを策定する

従業員向けにセキュリティ研修を実施する

シャドーAIの実態把握と利用ログの管理体制を構築する

企業組織全体で安全に利用するためには、ルール作りと管理体制の構築が欠かせません。組織として取り組むべき具体的な運用方法を解説します。

社内でAI利用ガイドラインを策定する

入力してよい情報と禁止する情報の範囲を明確に定めた、社内独自のルールブックを作成する必要があります。

利用するための申請手続きや、上司の承認を得る流れなど、具体的な運用ルールを設計して全従業員に周知します。

人工知能の技術は日々進化しているため、ガイドラインは定期的に見直し、最新の状況に合わせて更新する体制を整えましょう。明確な基準を設けるため、現場の社員が迷わず安全に利用できる環境を構築できます。

従業員向けにセキュリティ研修を実施する

機密情報を入力する危険性を、実際の漏洩事故を交えながら研修で伝える取り組みが重要です。

生成AIがどのようにデータを処理しているのか、基本的な仕組みに関する知識を全従業員に教育しましょう。

研修は一度きりで終わらせず、定期的な学習の機会を設けて、組織全体の防犯意識を継続的に高めていく姿勢が求められます。組織を守るためには、従業員一人ひとりの理解を深める取り組みが欠かせません。

シャドーAIの実態把握と利用ログの管理体制を構築する

会社が許可していない個人のアカウントで生成AIを利用する、「シャドーAI」と呼ばれる行為の実態を把握する必要があります。

組織全体の利用状況を目に見える形にし、定期的に監査を行う仕組みを構築してください。許可されていないツールの利用を自動で検知するシステムを導入すれば、予期せぬ情報漏洩のリスクを防げます。

会社が管理できない場所での利用をなくし、安全な環境下でのみ活用させる運用を徹底しましょう。

ChatGPTを活用した業務効率化なら「workrun」の安心・安全なAIワークフロー

安全に業務を自動化したい企業には、AIを組み込んだワークフローを構築できる「workrun」の導入がおすすめです。workrunの強みは以下のとおりです。

セキュリティ性が高く安心して利用できる

ChatGPTやNotionを含む300以上のツールと連携できる

生成AIと連携したワークフローが直感的に構築できる

実際の業務でどのように活用できるのか、具体的な機能と導入のメリットを紹介します。

セキュリティ性が高く安心して利用できる

workrunなら、企業利用を前提に設計されたセキュリティ環境のもと、ChatGPTを業務フローに組み込んだワークフローを構築できます。

ChatGPTの活用をワークフローとして設計することで、ツール間のデータ連携や処理を一元管理でき、情報の取り扱いをコントロールしながら安全に運用可能です。

また、チームでの利用に対応しているため、個人単位でのAI利用を抑え、シャドーAIの発生を抑止しながら、組織として統制の取れたAI活用を実現できます。

さらに、国内データセンターにも対応しており、企業のセキュリティ要件に配慮した形でAI活用を推進できます。安心して継続的に運用できる環境を提供します。

ChatGPTやNotionを含む300以上のツールと連携できる

workrunは、普段の業務で利用している多様なソフトウェアと連携し、仕事の幅を大きく広げられます。

文章作成AIや社内文書を管理するNotionなど、300種類以上の外部サービスと接続して情報をやり取りできます。

複数のシステムをまたいだ作業を一つにまとめられるため、情報を手作業で移す手間や入力ミスを削減可能です。

また、使い慣れたツールをそのまま活かしながら、最新の技術を取り入れられる点も魅力です。

生成AIと連携したワークフローが直感的に構築できる

workrunは、専門的なプログラミングの知識がなくても、画面上の操作だけで簡単に業務の流れを自動化できます。

例えば、顧客からの問い合わせ対応を自動化する仕組みも簡単に構築可能です。問い合わせを受信すると、AIが内容を分類して担当者を判定し、自動で回答の案を作成してチャットで通知します。

担当者は提案された文章を確認して送信するだけになるため、本来人が担うべき重要な業務にリソースを充てられるようになります。

ChatGPTを安全に利用できる社内体制を構築しよう

ChatGPTは便利なツールである反面、入力したデータが学習に利用されたり、アカウントが流出したりする危険性があります。

そのため、法人向けプランの導入や、社内ルールの策定など、組織全体で安全に利用する体制を整えなければなりません。

また、ChatGPTを安全に運用していくためにも、全社的にナレッジを共有し、安全に対する意識を高めていきましょう。

▼Chat GPTを活用した業務の自動化を安全・安心に進めたいなら、「workrun」!

workrunは、さまざまなツールやChatGPTなどのAIを連携し、業務プロセスを自動化・標準化できるAIワークフロー自動化ツールです。

これまで担当者ごとに対応方法が異なっていた問い合わせ対応や請求処理も、ワークフローとして整理・自動化することで、誰が対応しても同じ品質で業務を進められる体制を構築できます。

また、ノーコードで簡単にワークフローを作成できるため、現場主導で業務改善を進められる点も特長です。一度構築すれば24時間365日稼働し、業務の抜け漏れや対応遅れを防ぎます。

属人化しがちな業務を仕組み化することで、教育コストの削減や引き継ぎの負担軽減にもつながります。

「担当者に依存した業務から脱却したい」

そんな課題をお持ちの方は、ぜひ以下より詳細をご確認ください。